谷歌发布自研Arm服务器CPU:相比x86性能高50%、能效高60% |

|

珠江路在线

2024年4月12日

【

转载

】天龙八部开源网

|

|

本文标签:谷歌,cpu,Google |

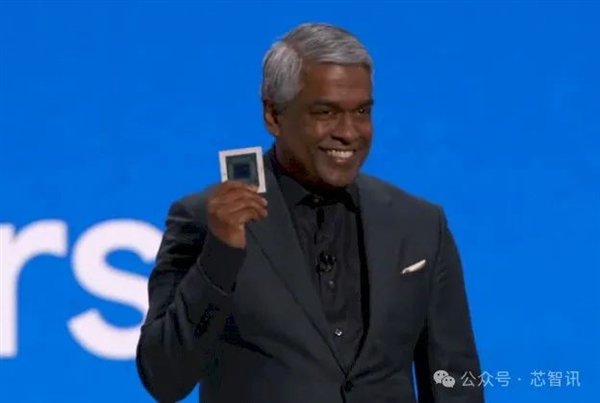

本地 工夫4月9日,在谷歌 举办的“Cloud Next 2024”大会上,谷歌首度公开了其专为数据 核心设计的首款自研Arm构架CPU――Axion 。

早在2023年2月就有传言称,谷歌正在开发两种不同的 Arm 服务器 CPU 。

其中一款代号为“Maple”,基于 Marvell 的技术,而且可能基于命运多舛的“Triton”ThunderX3及其后继产品 ThunderX4 。

第二个 名目代号为“Cypress”,由以色列的谷歌团队设计 。

据The next platform报导称,Maple 和 Cypress 都是由 Uri Frank 领导研发的,Uri Frank 于 2021 年 3 月从英特尔加入谷歌,成为服务器芯片设计副总裁 。

Frank 在英特尔工作了超过两年半的 工夫, 负责工程和治理职务,最后负责许多个人电脑核心芯片的设计 。

谷歌 Axion CPU 使用的是Arm “Demeter” V2 内核,而不是Arm 在今年 2 月公布的“Poseidon”V3 或“Hermes”N3 内核 。

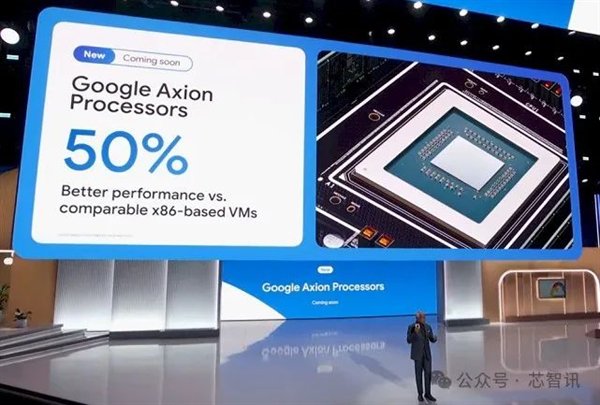

谷歌机器学习、系统和云 AI 总经理 Amin Vahdat 示意:“Axion 解决器将谷歌的芯片专业 常识与 Arm 最高性能的 CPU 内核相 联合,提供与当今云中最快的基于 Arm 的通用实例相比,这些实例的性能 遍及了 30%,与当前基于 X86 的同类实例相比,性能 遍及了 50%,能源效率 遍及了 60% 。”

Google Cloud副总裁暨运算和机器学习 根底设施总经理Mark Lohmeyer 示意:“Google Axion 构建在开放 根底上,任何地方 使用Arm构架的客户都能轻松采纳Axion CPU,无需再一次构架或编写 利用程序 。”

据谷歌云首席执行官托马斯・库里安(Thomas Kurian)介绍,Axion 芯片已经在谷歌内部投入生产(可能是有限的), 支撑 BigTable、Spanner、BigQuery、Blobstore、Pub/Sub、Google Earth Engine 和 YouTube 广告平台,今年晚些时候这些实例将在可供客户在 Google Cloud 上直接租用 。

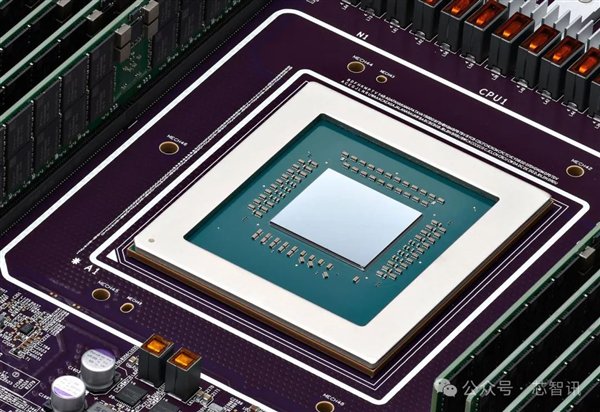

另外,Google Cloud还在上一年12月推出了下一代AI加快器TPU v5p, 能够用于训练一些规模最大、要求最高的生成式AI模型 。

单一TPU v5p Pod包括了8,960个芯片,是TPU v4 Pod芯片数量2倍以上 。

据介绍,Google Cloud不会对外销售Axion CPU、TPU v5p等芯片,而是提供给企业客户租用或 使用在 利用服务中 。

需求指出的是,当前亚马逊、微软、阿里云、百度等很多的云服务提供商都有依赖于英伟达、英特尔、AMD等芯片创造 搭档提供的芯片,然而他们也有自研的定制化Arm服务器芯片和AI加快芯片,以便更好的服务客户,减低关于外部供给商的依赖,减低成本 。